Details zur Funktionsweise

Hey Siri: iPhone stellenweise besonders aufmerksam

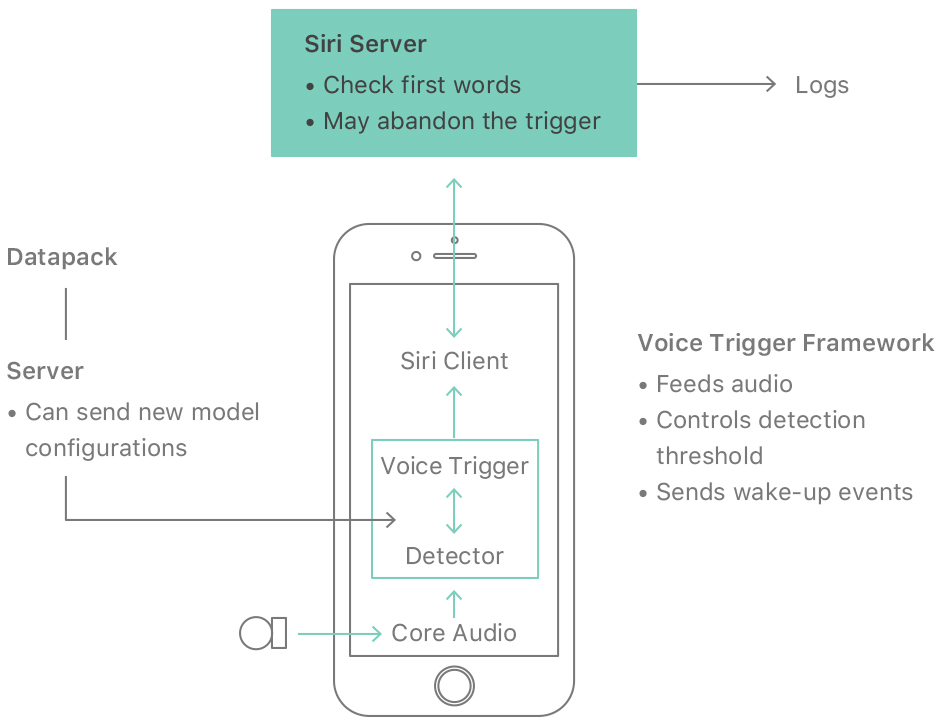

In dem seit Sommer erreichbaren Forschungs-Blog Apples, dem sogenannten Machine Learning Journal, hat Cupertino jetzt erste Hintergrundinformationen zur Funktionsweise der von iPhone, iPad und Apple Watch genutzten Erkennung der Siri-Aktivierungsphrase „Hey Siri“ gegeben.

Unter der Überschrift „Hey Siri: Voice Trigger for Apple’s Personal Assistant“ geht Apple auf die Energiespar-Mechanismen der Spracherkennung ein, erklärt wie das Unternehmen versucht versehentlichen Aktivierungen entgegenzuwirken und beschreibt, wie die stets aktive Worterkennung unter der Haube arbeitet.

So analysieren Apple Watch und iPhone die Umgebungsgeräusche im Raum 16.000 mal pro Sekunde und prüfen dabei kontinuierlich, ob der Nutzer vielleicht gerade ein “Hey Siri” von sich gegeben hat.

iPhone stellenweise besonders aufmerksam

Die Spracherkennung arbeitet dabei nicht linear, sondern spitz ihre Ohren und lauscht stellenweise besonders angestrengt. So bewertet das iPhone die gerade gehörten Geräusche mit einer Gewichtung, die angibt wie hoch die Wahrscheinlichkeit ist, dass der Nutzer gerade “Hey Siri” gesagt hat.

Eine Gewichtung, die ihr euch wie eine kontinuierliche Punktevergabe vorstellen könnt. Ein Beispiel: 16.000 mal pro Sekunde bewertet das iPhone, ob die gerade gehörten Geräusche ein “Hey Siri” beinhalten könnten und vergibt Punkte von 0-100. Werden mehr als 70 Punkte vergeben wird Siri aktiviert. Werden weniger als 70 Punkte vergeben, bleibt Siri stumm.

Doch Apple hat hier eine Besonderheit implementiert. Wurden weniger als 70 aber mehr als 50 Punkte vergeben, spitzt das iPhone kurz die Ohren. Werden jetzt noch mal mehr als 50 Punkte vergeben wird Siri auch dann aktiviert, wenn die 70 Punkte wieder nicht erreicht wurden.

Apples Ingenieure gehen jetzt einfach davon aus, dass der Nutzer Siri aktivieren wollte, beim ersten Mal nicht die nötigen Punkte bekommen hat und die Aktivierung noch mal versucht hat. Um nun schnell reagieren zu können wird die Messlatte reduziert:

We compare the score with a threshold to decide whether to activate Siri. In fact the threshold is not a fixed value. We built in some flexibility to make it easier to activate Siri in difficult conditions while not significantly increasing the number of false activations. There is a primary, or normal threshold, and a lower threshold that does not normally trigger Siri. If the score exceeds the lower threshold but not the upper threshold, then it may be that we missed a genuine “Hey Siri” event.

When the score is in this range, the system enters a more sensitive state for a few seconds, so that if the user repeats the phrase, even without making more effort, then Siri triggers. This second-chance mechanism improves the usability of the system significantly, without increasing the false alarm rate too much because it is only in this extra-sensitive state for a short time. (We discuss testing and tuning for accuracy later.)

Das komplette Paper könnt ihr hier einsehen.